METEOR - METEOR

METEOR ( Metric Ewaluacji słowami z wyraźnymi zamawiania ) jest metryka dla oceny wydajności tłumaczenia maszynowego . Metryka jest oparta na średniej harmonicznej precyzji unigramu i odwołania , przy czym odwołanie jest ważone wyżej niż precyzja. Posiada również kilka funkcji, które nie występują w innych wskaźników, takich jak wynikające i synonimia dopasowanie wraz ze standardowym dokładnego dopasowania tekstu. Miernik został zaprojektowany, aby rozwiązać niektóre problemy występujące w bardziej popularnej metryce BLEU , a także zapewnić dobrą korelację z ludzką oceną na poziomie zdania lub segmentu. Różni się to od metryki BLEU tym, że BLEU szuka korelacji na poziomie korpusu.

Przedstawiono wyniki, które dają korelację do 0,964 z oceną człowieka na poziomie korpusu, w porównaniu z osiągnięciem BLEU wynoszącym 0,817 na tym samym zestawie danych. Na poziomie zdania maksymalna korelacja z oceną człowieka wyniosła 0,403.

Algorytm

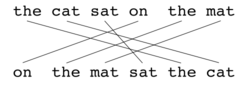

Podobnie jak w przypadku BLEU , podstawową jednostką oceny jest zdanie, algorytm najpierw tworzy wyrównanie (patrz ilustracje) między dwoma zdaniami , ciągiem tłumaczenia kandydata i ciągiem tłumaczenia odniesienia. Wyrównanie to zbiór odwzorowań między unigrams . Mapowanie można traktować jako linię między unigramem w jednym ciągu a unigramem w innym ciągu. Ograniczenia są następujące; każdy unigram w tłumaczeniu kandydata musi być odwzorowany na zero lub jeden unigram w odwołaniu. Odwzorowania są wybierane w celu utworzenia linii trasowania, jak określono powyżej. Jeśli istnieją dwie linie trasowania z taką samą liczbą odwzorowań, linia trasowania jest wybierana z najmniejszą liczbą krzyży , to znaczy z mniejszą liczbą przecięć dwóch odwzorowań. Z dwóch pokazanych linii trasowania, linia (a) zostanie wybrana w tym miejscu. Etapy są uruchamiane po kolei, a każdy etap dodaje do wyrównania tylko te unigramy, które nie zostały dopasowane w poprzednich etapach. Po obliczeniu ostatecznego wyrównania wynik jest obliczany w następujący sposób: Precyzja Unigramu P jest obliczana jako:

| Moduł | Kandydat | Odniesienie | Mecz |

|---|---|---|---|

| Dokładny | Dobrze | Dobrze | tak |

| Stemmer | Dobra | Dobrze | tak |

| Synonimia | dobrze | Dobrze | tak |

Gdzie m jest liczbą unigramów w tłumaczeniu kandydata, które znajdują się również w tłumaczeniu odniesienia, i jest liczbą unigramów w tłumaczeniu kandydata. Przywołanie Unigramu R jest obliczane jako:

Gdzie m jest jak powyżej i jest liczbą unigramów w tłumaczeniu odniesienia. Precyzja i przywracanie są łączone przy użyciu średniej harmonicznej w następujący sposób, przy czym przywracanie jest ważone 9 razy więcej niż precyzja:

Wprowadzone do tej pory środki uwzględniają zgodność tylko w odniesieniu do pojedynczych słów, ale nie w odniesieniu do większych segmentów, które pojawiają się zarówno w odwołaniu, jak i zdaniu kandydującym. Aby wziąć to pod uwagę, do obliczenia kary p za wyrównanie używane są dłuższe dopasowania n- gramów . Im więcej jest odwzorowań, które nie sąsiadują ze sobą w odwołaniu i zdaniu kandydującym, tym wyższa będzie kara.

Aby obliczyć tę karę, unigramy są grupowane w najmniejszą możliwą liczbę porcji , przy czym porcja jest definiowana jako zbiór unigramów sąsiadujących w hipotezie i w odwołaniu. Im dłuższe sąsiednie mapowania między kandydatem a referencją, tym mniej jest fragmentów. Tłumaczenie identyczne z referencją da tylko jeden fragment. Kara p jest obliczana w następujący sposób:

Gdzie c jest liczbą porcji i jest liczbą zmapowanych unigramów. Ostateczny wynik segmentu jest obliczany jako M poniżej. Kara skutkuje zmniejszeniem nawet o 50% w przypadku braku bigramu lub dłuższych meczów.

Aby obliczyć wynik dla całego korpusu lub zbioru segmentów, zbierane są zagregowane wartości P , R i p , a następnie łączone przy użyciu tego samego wzoru. Algorytm działa również w celu porównania tłumaczenia kandydującego z więcej niż jednym tłumaczeniem referencyjnym. W tym przypadku algorytm porównuje kandydata z każdym z referencji i wybiera najwyższy wynik.

Przykłady

| Odniesienie | the | kot | sat | na | the | mata |

|---|---|---|---|---|---|---|

| Hipoteza | na | the | mata | sat | the | kot |

| Wynik | ||||||

| Fmean | ||||||

| Rzut karny | ||||||

| Podział | ||||||

| Odniesienie | the | kot | sat | na | the | mata |

|---|---|---|---|---|---|---|

| Hipoteza | the | kot | sat | na | the | mata |

| Wynik | ||||||

| Fmean | ||||||

| Rzut karny | ||||||

| Podział | ||||||

| Odniesienie | the | kot | sat | na | the | mata | |

|---|---|---|---|---|---|---|---|

| Hipoteza | the | kot | był | sat | na | the | mata |

| Wynik | |||||||

| Fmean | |||||||

| Rzut karny | |||||||

| Podział | |||||||

Zobacz też

- NIEBIESKI

- Miara F

- NIST (metryczny)

- ROUGE (metryczny)

- Współczynnik błędów słów (WER)

- LEPOR

- Chunking rzeczownikowy

Uwagi

- ^ Banerjee, S. i Lavie, A. (2005)

Bibliografia

- Banerjee, S. i Lavie, A. (2005) „METEOR: automatyczny miernik oceny MT z ulepszoną korelacją z osądami ludzkimi” w materiałach warsztatowych na temat wewnętrznych i zewnętrznych środków oceny MT i/lub podsumowania na 43. dorocznym spotkaniu the Association of Computational Linguistics (ACL-2005), Ann Arbor, Michigan, czerwiec 2005

- Lavie, A., Sagae, K. i Jayaraman, S. (2004) „The Significance of Recall in Automatic Metrics for MT Evaluation” w Proceedings of AMTA 2004, Washington DC. wrzesień 2004

Linki zewnętrzne

- System automatycznej oceny tłumaczeń maszynowych METEOR (w tym link do pobrania)