Oś czasu uczenia maszynowego - Timeline of machine learning

Ta strona to oś czasu uczenia maszynowego . Uwzględniono główne odkrycia, osiągnięcia, kamienie milowe i inne ważne wydarzenia.

Przegląd

| Dekada | Streszczenie |

|---|---|

| <lata pięćdziesiąte XX wieku | Metody statystyczne są odkrywane i udoskonalane. |

| 1950 | Pionierskie badania nad uczeniem maszynowym prowadzone są przy użyciu prostych algorytmów. |

| 1960 | Metody bayesowskie zostały wprowadzone do wnioskowania probabilistycznego w uczeniu maszynowym. |

| lata 70. | „ Zima AI ” spowodowana pesymizmem na temat skuteczności uczenia maszynowego. |

| lata 80. | Ponowne odkrycie wstecznej propagacji powoduje odrodzenie badań nad uczeniem maszynowym. |

| 1990 | Praca nad uczeniem maszynowym przechodzi od podejścia opartego na wiedzy do podejścia opartego na danych. Naukowcy zaczynają tworzyć programy dla komputerów, które analizują duże ilości danych i wyciągają wnioski – lub „uczą się” – z wyników. Popularne stają się maszyny wektora nośnego (SVM) i rekurencyjne sieci neuronowe (RNN). Rozpoczęto tworzenie pól złożoności obliczeniowej poprzez sieci neuronowe i obliczenia super-Turinga. |

| 2000s | Klastrowanie wektorów wsparcia i inne metody jądra oraz nienadzorowane metody uczenia maszynowego stają się powszechne. |

| 2010s | Głębokie uczenie staje się wykonalne, co prowadzi do tego, że uczenie maszynowe staje się integralną częścią wielu powszechnie używanych usług i aplikacji oprogramowania. |

Oś czasu

| Rok | Typ wydarzenia | Podpis | Wydarzenie |

|---|---|---|---|

| 1763 | Odkrycie | Podstawy twierdzenia Bayesa | Praca Thomasa Bayesa Esej o rozwiązaniu problemu w doktrynie szans, opublikowana dwa lata po jego śmierci, została poprawiona i zredagowana przez przyjaciela Bayesa, Richarda Price'a . Esej przedstawia pracę leżącą u podstaw twierdzenia Bayesa . |

| 1805 | Odkrycie | Najmniejszy kwadrat | Adrien-Marie Legendre opisuje „metodę des moindres carrés”, znaną w języku angielskim jako metoda najmniejszych kwadratów . Metoda najmniejszych kwadratów jest szeroko stosowana w dopasowywaniu danych . |

| 1812 | Twierdzenie Bayesa | Pierre-Simon Laplace publikuje Théorie Analytique des Probabilités , w której rozwija prace Bayesa i definiuje to, co jest obecnie znane jako Twierdzenie Bayesa . | |

| 1913 | Odkrycie | Łańcuchy Markowa | Andrey Markov po raz pierwszy opisuje techniki, których używał do analizy wiersza. Techniki później stały się znane jako łańcuchy Markowa . |

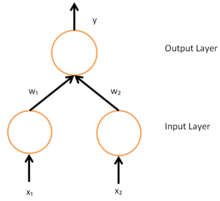

| 1943 | Odkrycie | Sztuczny neuron | Warren McCulloch i Walter Pitts opracowują model matematyczny, który imituje funkcjonowanie neuronu biologicznego, sztucznego neuronu uważanego za pierwszy wynaleziony model neuronowy. |

| 1950 | Maszyna do nauki Turinga | Alan Turing proponuje „uczącą się maszynę”, która mogłaby się uczyć i stać się sztucznie inteligentną. Konkretna propozycja Turinga zapowiada algorytmy genetyczne . | |

| 1951 | Pierwsza maszyna sieci neuronowej | Marvin Minsky i Dean Edmonds zbudowali pierwszą maszynę sieci neuronowej, zdolną do uczenia się, SNARC . | |

| 1952 | Maszyny grające w warcaby | Arthur Samuel dołącza do IBM Poughkeepsie Laboratory i zaczyna pracować nad jednymi z pierwszych programów uczenia maszynowego, najpierw tworząc programy, które grają w warcaby . | |

| 1957 | Odkrycie | Perceptron | Frank Rosenblatt wynalazł perceptron podczas pracy w Cornell Aeronautical Laboratory . Wynalezienie perceptronu wywołało wiele emocji i było szeroko komentowane w mediach. |

| 1963 | Osiągnięcie | Maszyny grające w kółko i krzyżyk | Donald Michie tworzy „maszynę” składający się z 304 pól Mecz i koralików, która wykorzystuje wzmocnienie uczenia się grać Kółko i krzyżyk (znany także jako kółko i krzyżyk). |

| 1967 | Najbliższy sąsiad | Powstał algorytm najbliższego sąsiada , który jest początkiem podstawowego rozpoznawania wzorców. Algorytm został wykorzystany do mapowania tras. | |

| 1969 | Ograniczenia sieci neuronowych | Marvin Minsky i Seymour Papert publikują swoją książkę Perceptrons , opisującą niektóre ograniczenia perceptronów i sieci neuronowych. Interpretacja, którą książka pokazuje, że sieci neuronowe są zasadniczo ograniczone, jest postrzegana jako przeszkoda w badaniach nad sieciami neuronowymi. | |

| 1970 | Automatyczne różnicowanie (propagacja wsteczna) | Seppo Linnainmaa publikuje ogólną metodę automatycznego różnicowania (AD) dyskretnych połączonych sieci zagnieżdżonych funkcji różniczkowalnych. Odpowiada to współczesnej wersji wstecznej propagacji, ale nie jest jeszcze tak nazwane. | |

| 1979 | Wózek Stanforda | Studenci Uniwersytetu Stanforda opracowują wózek, który może nawigować i omijać przeszkody w pomieszczeniu. | |

| 1979 | Odkrycie | Neokognitron | Kunihiko Fukushima po raz pierwszy publikuje swoją pracę na temat neokognitronu , rodzaju sztucznej sieci neuronowej (ANN). Neopoznanie później inspiruje konwolucyjne sieci neuronowe (CNN). |

| 1981 | Wyjaśnienie oparte na uczeniu się | Gerald Dejong wprowadza Wyjaśnienie Oparte na Uczeniu, gdzie algorytm komputerowy analizuje dane i tworzy ogólną zasadę, której może przestrzegać i odrzucać nieistotne dane. | |

| 1982 | Odkrycie | Rekurencyjna sieć neuronowa | John Hopfield popularyzuje sieci Hopfielda , rodzaj rekurencyjnej sieci neuronowej, która może służyć jako systemy pamięci adresowalnej treścią . |

| 1985 | NetTalk | Terry Sejnowski opracował program, który uczy się wymawiać słowa w taki sam sposób, jak dziecko. | |

| 1986 | Podanie | Propagacja wsteczna | Odwrócony tryb automatycznego różnicowania Seppo Linnainmaa (po raz pierwszy zastosowany do sieci neuronowych przez Paula Werbosa ) jest używany w eksperymentach Davida Rumelharta , Geoffa Hintona i Ronalda J. Williamsa do uczenia się reprezentacji wewnętrznych . |

| 1989 | Odkrycie | Nauka wzmacniania | Christopher Watkins opracowuje Q-learning , który znacznie poprawia praktyczność i wykonalność uczenia się przez wzmacnianie . |

| 1989 | Komercjalizacja | Komercjalizacja uczenia maszynowego na komputerach osobistych | Axcelis, Inc. wydaje Evolver , pierwszy pakiet oprogramowania, który komercjalizuje wykorzystanie algorytmów genetycznych na komputerach osobistych. |

| 1992 | Osiągnięcie | Maszyny grające w tryktraka | Gerald Tesauro opracowuje TD-Gammon , komputerowy program do gry w tryktraka , który wykorzystuje sztuczną sieć neuronową wytrenowaną przy użyciu uczenia różnic czasowych (stąd „TD” w nazwie). TD-Gammon jest w stanie rywalizować, ale nie zawsze przewyższać zdolności najlepszych graczy w backgammon. |

| 1995 | Odkrycie | Algorytm losowego lasu | Tin Kam Ho publikuje artykuł opisujący losowe lasy decyzyjne . |

| 1995 | Odkrycie | Maszyny wektorów nośnych | Corinna Cortes i Vladimir Vapnik publikują swoje prace na temat maszyn wektora nośnego . |

| 1997 | Osiągnięcie | IBM Deep Blue bije Kasparowa | IBM Deep Blue pokonuje mistrza świata w szachach. |

| 1997 | Odkrycie | LSTM | Sepp Hochreiter i Jürgen Schmidhuber wymyślać długo pamięć krótkotrwałą sieci (LSTM) o charakterze powtarzającym neuronowe, znacznie poprawia wydajność i praktyczność nawracających sieciach neuronowych. |

| 1998 | Baza danych MNIST | Zespół kierowany przez Yanna LeCuna publikuje bazę danych MNIST , zbiór danych składający się z kombinacji odręcznych cyfr pochodzących od pracowników Amerykańskiego Biura Spisu Ludności i amerykańskich uczniów szkół średnich. Baza danych MNIST stała się od tego czasu punktem odniesienia dla oceny rozpoznawania pisma ręcznego . | |

| 2002 | Biblioteka do uczenia maszynowego palnika | Torch , biblioteka oprogramowania do uczenia maszynowego, została wydana po raz pierwszy. | |

| 2006 | Nagroda Netflix | Konkurs Netflix Prize uruchamia Netflix . Celem konkursu było wykorzystanie uczenia maszynowego do pobicia dokładności własnego oprogramowania rekomendacyjnego Netflixa w przewidywaniu oceny użytkownika dla filmu na podstawie ocen poprzednich filmów o co najmniej 10%. Nagroda została zdobyta w 2009 roku. | |

| 2009 | Osiągnięcie | ImageNet | Powstaje ImageNet . ImageNet to duża wizualna baza danych stworzona przez Fei-Fei Li z Uniwersytetu Stanforda, który zdał sobie sprawę, że najlepsze algorytmy uczenia maszynowego nie działałyby dobrze, gdyby dane nie odzwierciedlały rzeczywistego świata. Dla wielu ImageNet był katalizatorem boomu AI w XXI wieku. |

| 2010 | Konkurs Kaggle | Rusza Kaggle , serwis, który służy jako platforma dla zawodów w uczeniu maszynowym. | |

| 2011 | Osiągnięcie | Pokonywanie ludzi w niebezpieczeństwie | Za pomocą kombinacji uczenia maszynowego, przetwarzania języka naturalnego i informacyjnych technik wyszukiwawczych, IBM „s Watson bije dwóch mistrzów człowieka w Jeopardy! konkurencja. |

| 2012 | Osiągnięcie | Rozpoznawanie kotów na YouTube | Zespół Google Brain pod kierownictwem Andrew Ng i Jeffa Deana tworzy sieć neuronową, która uczy się rozpoznawać koty, oglądając nieoznakowane obrazy z ramek filmów w YouTube . |

| 2014 | Skok w rozpoznawaniu twarzy | Badacze Facebooka publikują swoje prace na DeepFace , systemie wykorzystującym sieci neuronowe, który identyfikuje twarze z 97,35% dokładnością. Wyniki to poprawa o ponad 27% w porównaniu z poprzednimi systemami i konkurująca z ludzką wydajnością. | |

| 2014 | Sybilla | Badacze z Google szczegółowo opisują swoją pracę nad Sibyl, zastrzeżoną platformą do masowo równoległego uczenia maszynowego, używaną wewnętrznie przez Google do przewidywania zachowań użytkowników i dostarczania rekomendacji. | |

| 2016 | Osiągnięcie | Pokonywanie ludzi w Go | Program AlphaGo firmy Google staje się pierwszym programem Computer Go , który pokonał niepełnosprawnych profesjonalnego gracza, wykorzystując połączenie uczenia maszynowego i technik wyszukiwania drzew. Później ulepszony jako AlphaGo Zero, a następnie w 2017 uogólniony na szachy i inne gry dwuosobowe z AlphaZero . |

Zobacz też

- Historia sztucznej inteligencji

- Nauczanie maszynowe

- Kalendarium sztucznej inteligencji

- Kalendarium tłumaczenia maszynowego