Model autoregresyjny - Autoregressive model

W statystyce, ekonometrii i przetwarzaniu sygnałów model autoregresyjny ( AR ) jest reprezentacją pewnego rodzaju procesu losowego; jako taki, jest używany do opisu pewnych zmiennych w czasie procesów w przyrodzie, ekonomii itp. Model autoregresyjny określa, że zmienna wyjściowa zależy liniowo od swoich własnych wcześniejszych wartości i od składnika stochastycznego (niedoskonale przewidywalnego składnika); zatem model ma postać stochastycznego równania różnicowego (lub relacji rekurencyjnej, której nie należy mylić z równaniem różniczkowym). Wraz z modelem średniej ruchomej (MA) jest to szczególny przypadek i kluczowy składnik bardziej ogólnych modeli szeregów czasowych z autoregresyjną średnią kroczącą (ARMA) i autoregresyjną zintegrowaną średnią kroczącą (ARIMA), które mają bardziej skomplikowany stochastyczny charakter. Struktura; jest to również szczególny przypadek modelu autoregresji wektorowej (VAR), który składa się z układu więcej niż jednego zazębiającego się równania różnicy stochastycznej w więcej niż jednej ewoluującej zmiennej losowej.

W przeciwieństwie do modelu ze średnią ruchomą (MA), model autoregresyjny nie zawsze jest stacjonarny, ponieważ może zawierać pierwiastek jednostkowy.

Definicja

Zapis wskazuje na autoregresyjny model porządku p . Model AR( p ) jest zdefiniowany jako

gdzie są parametry modelu, jest stałą i jest białym szumem . Można to równoważnie zapisać za pomocą operatora przesunięcia wstecz B jako

tak, że przenosząc wyraz sumujący na lewą stronę i używając notacji wielomianowej , mamy

Model autoregresyjny można zatem postrzegać jako wyjście wielobiegunowego filtru o nieskończonej odpowiedzi impulsowej, którego wejściem jest biały szum.

Niektóre ograniczenia parametrów są niezbędne, aby model pozostał nieruchomy w szerokim sensie . Na przykład procesy w modelu AR(1) z nie są stacjonarne. Bardziej ogólnie, aby model AR( p ) był stacjonarny o szerokim znaczeniu, pierwiastki wielomianu muszą leżeć poza okręgiem jednostkowym , tj. każdy (złożony) pierwiastek musi spełniać (patrz strony 88,90).

Międzyokresowy efekt wstrząsów

W procesie AR jednorazowy szok wpływa na wartości ewoluującej zmiennej nieskończenie daleko w przyszłość. Rozważmy na przykład model AR(1) . Niezerowa wartość dla powiedzmy czasu t =1 wpływa na ilość . Następnie przez równanie AR dla pod względem , wpływa to na ilość . Następnie z równania AR dla pod względem , wpływa to na ilość . Kontynuacja tego procesu pokazuje, że efekt nigdy się nie kończy, chociaż jeśli proces jest nieruchomy, wówczas efekt zmniejsza się do zera w granicy.

Ponieważ każdy wstrząs wpływa na wartości X nieskończenie daleko w przyszłość od momentu ich wystąpienia, na każdą dana wartość X t wpływają wstrząsy występujące nieskończenie daleko w przeszłości. Można to również zobaczyć, przepisując autoregresję

(gdzie stały składnik został stłumiony przez założenie, że zmienna została zmierzona jako odchylenia od jej średniej) as

Gdy przeprowadzany jest podział wielomianowy po prawej stronie, wielomian w zastosowanym operatorze przesunięcia wstecznego ma nieskończony porządek — to znaczy nieskończoną liczbę opóźnionych wartości pojawia się po prawej stronie równania.

Wielomian charakterystyczny

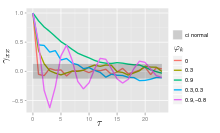

Funkcja autokorelacji procesu AR( p ) może być wyrażona jako

gdzie są pierwiastki wielomianu

gdzie B jest operatorem przesunięcia wstecz , gdzie jest funkcją definiującą autoregresję, a gdzie są współczynnikami autoregresji.

Funkcja autokorelacji procesu AR( p ) jest sumą zanikających wykładników.

- Każdy pierwiastek rzeczywisty wnosi składnik do funkcji autokorelacji, która zanika wykładniczo.

- Podobnie, każda para złożonych sprzężonych korzeni przyczynia się do wykładniczo tłumionej oscylacji.

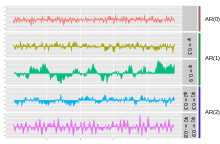

Wykresy procesów AR( p )

Najprostszym procesem AR jest AR(0), który nie ma zależności między terminami. Tylko pojęcie błędu/innowacji/szumu ma wpływ na wynik procesu, więc na rysunku AR(0) odpowiada białemu szumowi.

W przypadku procesu AR(1) z dodatnim , tylko poprzedni składnik w procesie i składnik szumu przyczyniają się do wyjścia. Jeśli jest bliski 0, proces nadal wygląda jak biały szum, ale gdy zbliża się do 1, wyjście otrzymuje większy wkład z poprzedniego składnika w stosunku do szumu. Powoduje to „wygładzenie” lub integrację wyjścia, podobnie jak w filtrze dolnoprzepustowym.

W przypadku procesu AR(2) dwa poprzednie składniki i składnik szumu mają wpływ na wyjście. Jeśli oba i są dodatnie, wyjście będzie przypominać filtr dolnoprzepustowy, ze zmniejszoną częścią szumu o wysokiej częstotliwości. Jeśli jest dodatnia, a ujemna, to proces sprzyja zmianom znaku pomiędzy elementami procesu. Wyjście oscyluje. Można to porównać do wykrywania krawędzi lub wykrywania zmiany kierunku.

Przykład: proces AR(1)

Proces AR(1) jest podany przez:

gdzie jest procesem białego szumu o zerowej średniej i stałej wariancji . (Uwaga: indeks dolny on został pominięty.) Proces jest szeroko rozumiany stacjonarny , ponieważ jest uzyskiwany jako wyjście stabilnego filtra, którego wejściem jest biały szum. (Jeśli wtedy wariancja zależy od opóźnienia czasowego t, tak że wariancja szeregu rozchodzi się do nieskończoności w miarę t zmierza do nieskończoności, a zatem nie jest stacjonarna w szerokim sensie.) Zakładając , średnia jest identyczna dla wszystkich wartości t przez samą definicję stacjonarności szeroko rozumianej. Jeżeli średnia jest oznaczona przez , to wynika z

że

i stąd

W szczególności, jeśli , to średnia wynosi 0.

Wariancja jest

gdzie jest odchylenie standardowe . Można to pokazać, zauważając, że

a następnie zauważając, że powyższa wielkość jest stabilnym, stałym punktem tej relacji.

Autokowariancji jest dana przez

Można zauważyć, że funkcja autokowariancji zanika z czasem zanikania (zwanym również stałą czasową ) [aby to zobaczyć, napisz gdzie jest niezależne od . Następnie zanotuj to i dopasuj do prawa rozkładu wykładniczego ].

Funkcja gęstości widmowej jest transformatą Fouriera funkcji autokowariancji. W kategoriach dyskretnych będzie to dyskretna transformata Fouriera:

Wyrażenie to jest okresowe ze względu na dyskretny charakter , który przejawia się jako wyraz cosinus w mianowniku. Jeśli założymy, że czas próbkowania ( ) jest znacznie mniejszy niż czas zaniku ( ), to możemy zastosować przybliżenie continuum do :

co daje profil Lorentza dla gęstości widmowej:

gdzie jest częstotliwość kątowa związana z czasem zaniku .

Alternatywne wyrażenie za można wyprowadzić, najpierw zastępując za w równaniu definiującym. Kontynuacja tego procesu N razy daje

Dla N zbliżającego się do nieskończoności, zbliży się do zera i:

Widać, że jest to biały szum splątany z jądrem plus stała średnia. Jeśli biały szum jest procesem gaussowskim, to jest to również proces gaussowski. W innych przypadkach centralne twierdzenie graniczne wskazuje, że będzie w przybliżeniu rozkład normalny, gdy jest bliski jedności.

Wyraźna forma średniej/różnicy procesu AR(1)

Model AR(1) jest analogią czasu dyskretnego do ciągłego procesu Ornsteina-Uhlenbecka . Dlatego czasami przydatne jest zrozumienie właściwości modelu AR(1) oddanego w równoważnej formie. W tej postaci model AR(1) wraz z parametrem procesu wyraża się wzorem :

- , gdzie i jest średnią modelu.

Umieszczając to w formularzu , a następnie rozszerzając serię o , można pokazać, że:

- , oraz

- .

Wybór maksymalnego opóźnienia

Częściowa autokorelacja procesu AR(p) jest równa zeru przy opóźnieniu, które nie jest większe niż rząd p i stanowi dobry model korelacji między i , więc odpowiednie maksymalne opóźnienie to takie, powyżej którego wszystkie autokorelacje cząstkowe wynoszą zero.

Obliczanie parametrów AR

Istnieje wiele sposobów oszacowania współczynników, takich jak zwykła procedura najmniejszych kwadratów lub metoda momentów (poprzez równania Yule'a-Walkera).

Model AR( p ) jest określony równaniem

Opiera się na parametrach, gdzie i = 1, ..., p . Istnieje bezpośrednia zgodność między tymi parametrami a funkcją kowariancji procesu i tę zależność można odwrócić, aby określić parametry z funkcji autokorelacji (która sama jest otrzymywana z kowariancji). Odbywa się to za pomocą równań Yule-Walker.

Równania Yule'a-Walkera

Równania Yule'a-Walkera, nazwane dla Udny Yule i Gilberta Walkera , są następującym zestawem równań.

gdzie m = 0, …, p , co daje równania p +1 . Oto funkcja autokowariancji X t , jest to odchylenie standardowe procesu szumu wejściowego i jest funkcją delta Kroneckera .

Ponieważ ostatnia część pojedynczego równania jest niezerowa tylko wtedy, gdy m = 0 , zbiór równań można rozwiązać, przedstawiając równania dla m > 0 w postaci macierzowej, otrzymując w ten sposób równanie

które można rozwiązać dla wszystkich Pozostałe równanie dla m = 0 to

które, gdy są znane, mogą być rozwiązane

Alternatywnym sformułowaniem jest sformułowanie funkcji autokorelacji . Parametry AR są określone przez pierwsze elementy p +1 funkcji autokorelacji. Pełną funkcję autokorelacji można następnie wyprowadzić, obliczając rekurencyjnie

Przykłady dla niektórych procesów AR( p ) niskiego rzędu

-

p =1

- Stąd

-

p = 2

- Równania Yule'a-Walkera dla procesu AR(2) to:

- Zapamietaj to

- Korzystanie z pierwszego równania daje

- Korzystanie z formuły rekurencji daje plony

- Równania Yule'a-Walkera dla procesu AR(2) to:

Estymacja parametrów AR

Powyższe równania (równania Yule'a-Walkera) dostarczają kilku sposobów szacowania parametrów modelu AR( p ), poprzez zastąpienie teoretycznych kowariancji wartościami szacunkowymi. Niektóre z tych wariantów można opisać w następujący sposób:

- Estymacja autokowariancji lub autokorelacji. Tutaj każdy z tych terminów jest szacowany oddzielnie, przy użyciu konwencjonalnych szacunków. Można to zrobić na różne sposoby, a wybór między nimi wpływa na właściwości schematu estymacji. Na przykład, niektóre wybory mogą spowodować negatywne oszacowania wariancji.

- Sformułowanie jako problem regresji metodą najmniejszych kwadratów, w którym konstruuje się zwykły problem predykcji metodą najmniejszych kwadratów, opierając przewidywanie wartości X t na p poprzednich wartościach tego samego szeregu. Można to traktować jako schemat przewidywania w przód. W normalnych równań tego problemu widać, odpowiadającą przybliżeniu w postaci macierzy równań Yule-Walker, w którym każdy występ o autokowariancji tego samego opóźnienia zastępuje się nieco inną oszacowania.

- Sformułowanie jako rozszerzona forma zwykłego zadania przewidywania najmniejszych kwadratów. Tutaj dwa zestawy równań prognostycznych są połączone w jeden schemat estymacji i pojedynczy zestaw równań normalnych. Jeden zestaw to zestaw równań przewidywania w przód, a drugi to odpowiedni zestaw równań przewidywania wstecznego, odnoszących się do wstecznej reprezentacji modelu AR:

- Tutaj przewidywane wartości X t byłyby oparte na p przyszłych wartościach tego samego szeregu. Ten sposób szacowania parametrów AR wynika z metody Burga i jest nazywany metodą Burga: Burg i późniejsi autorzy nazywali te konkretne szacunki „oszacowaniami maksymalnej entropii”, ale rozumowanie za tym odnosi się do użycia dowolnego zestawu estymowanych parametrów AR. W porównaniu ze schematem estymacji wykorzystującym tylko równania przewidywania w przód, powstają różne estymaty autokowariancji, a estymaty mają różne właściwości stabilności. Szacunki Burg są szczególnie związane z estymacją widmową maksymalnej entropii .

Inne możliwe podejścia do estymacji obejmują szacowanie maksymalnego prawdopodobieństwa . Dostępne są dwa różne warianty największej prawdopodobieństwa: w jednym (szeroko równoważnym schematowi najmniejszych kwadratów z przewidywaniem w przód) rozważana funkcja prawdopodobieństwa odpowiada rozkładowi warunkowemu późniejszych wartości w szeregu przy danych początkowych wartościach p w szeregu; w drugim rozważana jest funkcja wiarygodności odpowiadająca bezwarunkowemu łącznemu rozkładowi wszystkich wartości w obserwowanych szeregach. Istotne różnice w wynikach tych podejść mogą wystąpić, jeśli obserwowana seria jest krótka lub proces jest bliski niestacjonarności.

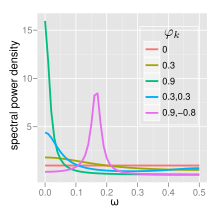

Widmo

Mocy widmowej gęstości (PSD) o AR ( p ) z procesu wariancji szumu jest

AR(0)

Dla białego szumu (AR(0))

AR(1)

Dla AR(1)

- Jeśli występuje pojedynczy pik widmowy przy f=0, często określany jako szum czerwony . Jak staje się bliższy 1, nie ma większą moc przy niskich częstotliwościach, czyli większych opóźnień czasowych. Jest to zatem filtr dolnoprzepustowy, po zastosowaniu do światła o pełnym spektrum, wszystko oprócz czerwonego światła zostanie przefiltrowane.

- Jeśli jest minimum przy f=0, często określane jako szum niebieski . Działa to podobnie jak filtr górnoprzepustowy, wszystko oprócz niebieskiego światła zostanie przefiltrowane.

AR(2)

Procesy AR(2) można podzielić na trzy grupy w zależności od cech ich korzeni:

- Kiedy , proces ma parę złożonych sprzężonych korzeni, tworząc szczyt średniej częstotliwości przy:

W przeciwnym razie proces ma prawdziwe korzenie i:

- Kiedy działa jako filtr dolnoprzepustowy na białym szumie ze szczytem widmowym przy

- Kiedy działa jako filtr górnoprzepustowy na biały szum ze szczytem widmowym przy .

Proces jest niestacjonarny, gdy korzenie znajdują się poza okręgiem jednostkowym. Proces jest stabilny, gdy pierwiastki znajdują się w okręgu jednostkowym lub równoważnie, gdy współczynniki znajdują się w trójkącie .

Pełną funkcję PSD można wyrazić w postaci rzeczywistej jako:

Wdrożenia w pakietach statystyk

- R , pakiet statystyk zawiera funkcję ar .

- Zestaw narzędzi Econometrics Toolbox i System Identification Toolbox firmy MATLAB zawiera modele autoregresyjne

- Matlab i Octave : zestaw narzędzi TSA zawiera kilka funkcji estymacji dla modeli jednowymiarowych, wielowymiarowych i adaptacyjnych modeli autoregresyjnych.

- PyMC3 : statystyka bayesowska i struktura programowania probabilistycznego obsługują tryby autoregresyjne z opóźnieniami p .

- bayesloop obsługuje wnioskowanie parametrów i wybór modelu dla procesu AR-1 ze zmiennymi w czasie parametrami.

- Python : implementacja w statsmodelach.

Odpowiedź impulsowa

Odpowiedź impulsowa systemu jest zmianą zmiennej ewoluującej w odpowiedzi na zmianę wartości składnika szokowego k okresów wcześniej, w funkcji k . Ponieważ model AR jest szczególnym przypadkiem modelu wektorowej autoregresji, stosuje się tutaj obliczanie odpowiedzi impulsowej w wektorowej autoregresji#odpowiedź impulsowa .

n – prognozowanie z wyprzedzeniem

Gdy parametry autoregresji

zostały oszacowane, autoregresja może być wykorzystana do prognozowania dowolnej liczby okresów w przyszłość. Pierwsze użycie t w odniesieniu do pierwszego okresu, dla którego dane nie są jeszcze dostępne; wstaw znane poprzednie wartości X t-i dla i= 1, ..., p do równania autoregresyjnego, ustawiając składnik błędu równy zero (ponieważ prognozujemy, że X t będzie równe jego wartości oczekiwanej, a wartość oczekiwana składnika błędu nieobserwowanego wynosi zero). Wynikiem równania autoregresyjnego jest prognoza dla pierwszego nieobserwowanego okresu. Następnie użyj t, aby odnieść się do następnego okresu, dla którego dane nie są jeszcze dostępne; ponownie równanie autoregresyjne jest używane do wykonania prognozy, z jedną różnicą: wartość X jeden okres przed tym, który jest obecnie prognozowany, nie jest znana, więc zamiast tego używana jest jej wartość oczekiwana — wartość przewidywana wynikająca z poprzedniego kroku prognozowania . Następnie dla przyszłych okresów stosuje się tę samą procedurę, za każdym razem stosując jeszcze jedną wartość prognozy po prawej stronie równania predykcyjnego, aż po p prognozach wszystkie p wartości po prawej stronie będą wartościami prognozowanymi z poprzednich etapów.

Istnieją cztery źródła niepewności dotyczące prognoz uzyskanych w ten sposób: (1) niepewność, czy model autoregresyjny jest modelem poprawnym; (2) niepewność co do dokładności prognozowanych wartości, które są używane jako wartości opóźnione po prawej stronie równania autoregresji; (3) niepewność co do prawdziwych wartości współczynników autoregresji; oraz (4) niepewność co do wartości składnika błędu dla przewidywanego okresu. Każdą z trzech ostatnich można określić ilościowo i połączyć w celu uzyskania przedziału ufności dla predykcji n -krokowych; przedział ufności będzie się poszerzał wraz ze wzrostem n ze względu na stosowanie coraz większej liczby szacowanych wartości dla zmiennych po prawej stronie.

Ocena jakości prognoz

Wydajność predykcyjną modelu autoregresyjnego można ocenić zaraz po wykonaniu estymacji, jeśli stosuje się walidację krzyżową . W tym podejściu część początkowo dostępnych danych została wykorzystana do celów estymacji parametrów, a część (z dostępnych później obserwacji w zestawie danych) została wstrzymana do testów poza próbą. Alternatywnie, po pewnym czasie od oszacowania parametrów, dostępnych będzie więcej danych i można będzie ocenić wydajność predykcyjną, a następnie przy użyciu nowych danych.

W obu przypadkach istnieją dwa aspekty wydajności predykcyjnej, które można ocenić: wydajność o jeden krok do przodu i wydajność n -kroku do przodu . W przypadku wykonania o jeden krok do przodu, oszacowane parametry są wykorzystywane w równaniu autoregresji wraz z obserwowanymi wartościami X dla wszystkich okresów poprzedzających ten, który jest przewidywany, a wynikiem równania jest prognoza z jednym krokiem naprzód; ta procedura jest używana do uzyskania prognoz dla każdej z obserwacji poza próbą. Aby ocenić jakość prognoz n -krokowych do przodu, do uzyskania prognoz stosuje się procedurę prognozowania opisaną w poprzedniej sekcji.

Mając zestaw przewidywanych wartości i odpowiadający im zestaw rzeczywistych wartości dla X dla różnych okresów czasu, powszechną techniką oceny jest użycie średniokwadratowego błędu przewidywania ; dostępne są również inne miary (patrz prognozowanie#dokładność prognozowania ).

Pojawia się pytanie, jak interpretować zmierzoną dokładność prognozowania — na przykład, jaka jest „wysoka” (zła) lub „niska” (dobra) wartość średniokwadratowego błędu prognozy? Istnieją dwa możliwe punkty porównania. Po pierwsze, do celów porównawczych można wykorzystać dokładność prognozowania alternatywnego modelu, oszacowanego przy różnych założeniach modelowania lub różnych technikach szacowania. Po drugie, miara dokładności poza próbą może być porównana z tą samą miarą obliczoną dla punktów danych w próbie (które zostały użyte do oszacowania parametrów), dla których dostępna jest wystarczająca ilość wcześniejszych wartości danych (tj. porzucenie pierwszych danych p punktów, dla których nie jest dostępnych p wcześniejszych punktów danych). Ponieważ model został oszacowany specjalnie tak, aby jak najlepiej pasował do punktów w próbce, zwykle będzie tak, że wydajność predykcyjna poza próbą będzie gorsza niż wydajność predykcyjna w próbce. Ale jeśli jakość predykcyjna pogorszy się poza próbą o „niewiele” (co nie jest precyzyjnie zdefiniowane), to prognostyk może być zadowolony z wyników.

Zobacz też

- Model średniej ruchomej

- Liniowe równanie różnicy

- Analityka predykcyjna

- Liniowe kodowanie predykcyjne

- Rezonans

- Rekurencja Levinsona

- Proces Ornsteina-Uhlenbecka

Uwagi

Bibliografia

- Mills, Terence C. (1990). Techniki szeregów czasowych dla ekonomistów . Wydawnictwo Uniwersytetu Cambridge.

- Percival, Donald B.; Walden, Andrew T. (1993). Analiza spektralna do zastosowań fizycznych . Wydawnictwo Uniwersytetu Cambridge.

- Pandit, Sudhakar M.; Wu, Shien-Ming (1983). Szeregi czasowe i analiza systemowa z aplikacjami . John Wiley & Synowie.

Zewnętrzne linki

- Analiza autoregresji (AR) Paula Bourke

- Wykład z ekonometrii (temat: Modele autoregresyjne) na YouTube autorstwa Marka Thoma

![{\ Displaystyle \ phi [B] X_ {t} = c + \ varepsilon _ {t} \,.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b384dd193d1b8b0063a997d5a8d65434a7908880)

![{\ Displaystyle \ operatorname {E} (X_ {t + n} | X_ {t}) = \ mu \ lewo [1-\ theta ^ {n} \ prawo] + X_ {t} \ theta ^ {n}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/57e7ce545d36dfb0de17a55881ba8322e99955a5)